La inteligencia artificial no deja de avanzar, sorprendiendo cada año con capacidades antes inimaginables. Si hace poco era la generación de texto lo que nos dejaba boquiabiertos, hoy el nuevo protagonista es el vídeo. Modelos como Sora de OpenAI, Runway Gen-3, Google Lumiere o Pika Labs han abierto la puerta a una creatividad sin límites… aunque no sin errores. ¿El problema? Que estas IAs aún no comprenden el mundo como lo hacemos los humanos.

Aquí es donde entra en escena Meta, con una propuesta revolucionaria que podría redefinir por completo el modo en que las IAs entienden —y reproducen— la realidad. Y lo mejor es que este cambio no solo afecta al arte digital o al entretenimiento, sino a todos los sectores donde la predicción y la simulación visual juegan un papel esencial: desde la robótica hasta el marketing digital, pasando por recursos humanos, UX/UI design o incluso la ciberseguridad.

🎬 ¿Qué hacen las IAs generadoras de vídeo y por qué son tan prometedoras?

Los generadores de vídeo por IA transforman instrucciones en texto o imágenes en secuencias de vídeo. Es decir, puedes escribir algo como “una mujer caminando por Marte mientras explora una base futurista” y ver cómo ese concepto cobra vida, con luces, movimiento, textura y profundidad. Impresionante, ¿verdad?

Estas herramientas están avanzando a pasos agigantados, con resultados cada vez más realistas. Pero hay un “pero”. Muchos vídeos terminan rompiendo las leyes de la física: sombras imposibles, caídas sin gravedad, colisiones que no afectan a los objetos… y eso tiene una explicación técnica.

🔬 La raíz del problema: física mal comprendida

Los modelos actuales de IA de vídeo han sido entrenados con millones de clips, tratando de aprender todo al mismo tiempo: cómo luce el mundo y cómo se comporta. Es decir, intentan entender la apariencia visual y la dinámica de movimiento con una sola red neuronal. Este planteamiento, aunque ambicioso, resulta poco efectivo.

📌 ¿Por qué? Porque cuando una IA aprende todo a la vez, puede acertar en los colores, texturas o formas… pero fallar estrepitosamente en cómo se mueven los objetos. Y eso rompe la magia. La consecuencia: vídeos bellos pero incoherentes.

🧠 Meta VideoJAM: el gran avance

Meta propone una solución tan elegante como poderosa: desacoplar el entrenamiento en dos tareas distintas:

- Aprender la apariencia visual del vídeo (cómo se ve cada objeto, fondo o figura).

- Aprender por separado el movimiento (cómo cambian de posición o estado a lo largo del tiempo).

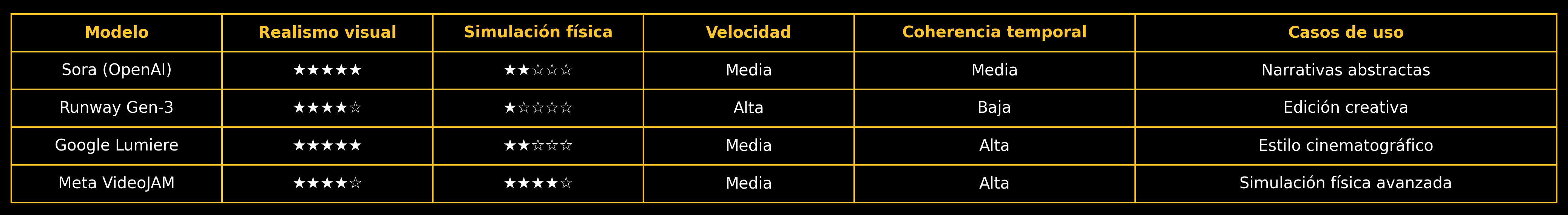

A este modelo lo han bautizado como Meta VideoJAM, y ha demostrado una mejora abrumadora en la generación de vídeos coherentes, físicos y realistas. De hecho, cuando se compara con Sora, Runway o Lumiere, VideoJAM consigue simular incluso pequeñas interacciones físicas: una vela que se apaga al soplar, agua que fluye y rebota, o el enfoque de una cámara al acercarse a un animal.

⚖️ Comparativa técnica: ¿quién domina el vídeo por IA?

💼 Aplicaciones prácticas por sectores

La mejora en la simulación realista no solo impacta en el cine o la publicidad. Estas IAs tienen aplicaciones concretas en muchas disciplinas:

- Data Science & Analytics: simulaciones visuales predictivas de comportamiento, proyecciones interactivas de datos y visualización 3D de modelos.

- UX/UI Design: prototipos animados con interacciones físicas realistas para testeo de producto.

- Marketing Digital: creación de vídeos de producto hiperrealistas, dinámicas publicitarias automatizadas, vídeos personalizados a escala.

- Recursos Humanos: generación de escenarios para entrenamiento en soft skills o evaluación situacional.

- Ciberseguridad: simulación visual de ataques o respuestas en entornos virtuales.

- Digital Product Management: testeo de funcionalidades o journeys completos en entornos visuales con feedback basado en IA.

- Inteligencia Artificial: desarrollo de sistemas que razonan antes de actuar visualmente, ideales para la robótica o la conducción autónoma.

🔍 ¿Y cómo se mide el avance?

Meta ha validado su modelo con pruebas científicas: mostró vídeos ordenados y desordenados a diferentes IAs. Mientras que otras no detectaban diferencia, VideoJAM sí. Su comprensión del tiempo y la física era superior.

Además, en pruebas prácticas, fue el único capaz de representar con éxito objetos que caen con diferente peso, trazos de pintura realistas y focos ópticos que se comportan como lo harían en el mundo real. Esto ha supuesto una mejora enorme con respecto a anteriores modelos que había lanzado la compañía, como Meta Movie Gen.

🚨 Domina la IA antes de que te domine a ti.

El futuro no va a esperarte. Aprende a usar la inteligencia artificial para transformar negocios, productos y tu carrera.

🚀 El presente (y futuro) de la IA visual

Estamos a las puertas de una nueva era: la de las IAs que razonan visualmente. Donde antes solo veíamos píxeles en movimiento, ahora se esconden cadenas de pensamiento, simulaciones, lógica y planificación. Y este cambio lo cambia todo.

Desde Nuclio Digital School, creemos firmemente que quienes comprendan estos avances no solo estarán mejor preparados para los desafíos del mañana, sino que serán quienes los lideren. Por eso, si sientes curiosidad por la IA, la innovación y su impacto real, te invitamos a explorar nuestro:

🎓 Máster en Inteligencia Artificial: Business & Innovation

Una formación completa, práctica y transformadora, pensada para mentes inquietas que quieren construir el futuro con la tecnología como aliada.